Die numerische Analyse stellt die akademische Disziplin dar, die sich auf Algorithmen konzentriert, die zur Bewältigung von Herausforderungen in der kontinuierlichen Mathematik entwickelt wurden. Diese Berechnungsmethoden beziehen sich im Gegensatz zu denen der diskreten Mathematik hauptsächlich auf reale oder komplexe Variablen und nutzen neben symbolischer Manipulation üblicherweise auch numerische Näherung.

Numerische Analyse ist das Studium von Algorithmen für die Probleme der kontinuierlichen Mathematik. Diese Algorithmen umfassen reale oder komplexe Variablen (im Gegensatz zur diskreten Mathematik) und nutzen typischerweise neben der symbolischen Manipulation auch numerische Approximationen.

Die Prinzipien der numerischen Analyse werden in allen Ingenieurdisziplinen und den Naturwissenschaften umfassend angewendet. Darüber hinaus hat sich sein Nutzen im 21. Jahrhundert auf die Lebens- und Sozialwissenschaften ausgeweitet, darunter Wirtschaftswissenschaften, Medizin, Wirtschaft und sogar die Künste. Die zunehmende Rechenleistung, die heute verfügbar ist, erleichtert den Einsatz komplexerer numerischer Analysetechniken und führt so zu äußerst detaillierten und genauen mathematischen Modellen für wissenschaftliche und technische Anwendungen. Anschauliche Beispiele für die numerische Analyse sind die Verwendung gewöhnlicher Differentialgleichungen in der Himmelsmechanik zur Vorhersage von Planeten-, Stern- und galaktischen Bewegungen; die Anwendung der numerischen linearen Algebra in der Datenanalyse; und die Verwendung stochastischer Differentialgleichungen und Markov-Ketten zur Simulation biologischer Zellen in medizinischen und biologischen Kontexten.

Vor dem Aufkommen der modernen Informatik beruhten numerische Methoden häufig auf manuellen Interpolationsformeln, bei denen Daten aus umfangreichen gedruckten Tabellen verwendet wurden. Ab der Mitte des 20. Jahrhunderts übernahmen Computer die Aufgabe, diese erforderlichen Funktionen zu berechnen; Eine beträchtliche Anzahl dieser Grundformeln findet jedoch weiterhin Anwendung in zeitgenössischen Softwarealgorithmen.

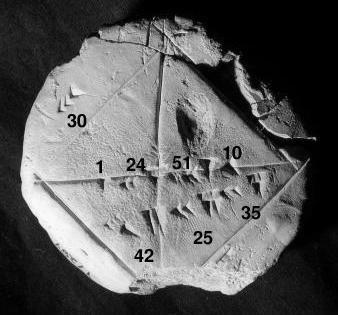

Die konzeptionelle Grundlage numerischer Ansätze lässt sich bis in die frühesten mathematischen Texte zurückverfolgen. Beispielsweise stellt eine Tafel mit der Bezeichnung YBC 7289, die sich in der Yale Babylonian Collection befindet, eine sexagesimale numerische Näherung für die Quadratwurzel von 2 dar, die die Länge der Diagonale in einem Einheitsquadrat darstellt.

Die numerische Analyse setzt dieses bleibende Erbe fort, indem sie Näherungslösungen innerhalb vordefinierter Fehlertoleranzen priorisiert, anstatt exakte symbolische Ergebnisse zu liefern, die dann in Ziffern umgewandelt werden und ausschließlich auf empirische Messungen anwendbar sind.

Anwendungen

Das übergeordnete Ziel im Bereich der numerischen Analyse besteht in der Entwicklung und Bewertung von Methoden, die in der Lage sind, ungefähre und dennoch präzise Lösungen für eine Vielzahl komplexer Probleme zu liefern, von denen viele nicht mit symbolischen Methoden gelöst werden können.

- Ausgefeilte numerische Methoden sind unabdingbar, um die praktische Umsetzung numerischer Wettervorhersagen zu ermöglichen.

- Die Bestimmung der Flugbahn eines Raumfahrzeugs erfordert die genaue numerische Auflösung eines Systems aus gewöhnlichen Differentialgleichungen.

- Automobilhersteller verbessern die Unfallsicherheit von Fahrzeugen durch den Einsatz von Computersimulationen von Fahrzeugkollisionen. Bei diesen Simulationen geht es im Wesentlichen um die numerische Lösung partieller Differentialgleichungen.

- Im Finanzsektor nutzen private Investmentfonds und andere Finanzinstitute quantitative Finanzinstrumente, die aus numerischen Analysen abgeleitet sind, um die Bewertung von Aktien und Derivaten präziser als andere Marktteilnehmer zu ermitteln.

- Fluggesellschaften nutzen fortschrittliche Optimierungsalgorithmen, um Ticketpreise zu bestimmen, Flugzeuge und Besatzung zuzuteilen und den Treibstoffbedarf zu verwalten. Historisch gesehen erfolgte die Entwicklung dieser Algorithmen im interdisziplinären Bereich des Operations Research.

- Versicherungsgesellschaften nutzen numerische Programme zur Durchführung versicherungsmathematischer Analysen.

Verlauf

Die Disziplin der numerischen Analyse ist mehrere Jahrhunderte älter als die Einführung der modernen Computertechnologie. Beispielsweise wurde die lineare Interpolation bereits vor über zwei Jahrtausenden eingesetzt. Zahlreiche prominente Mathematiker haben im Laufe der Geschichte der numerischen Analyse große Aufmerksamkeit gewidmet, eine Tatsache, die aus der Nomenklatur zentraler Algorithmen wie der Newton-Methode, dem Lagrange-Interpolationspolynom, der Gaußschen Eliminierung und der Euler-Methode hervorgeht. Während die Entstehung der zeitgenössischen numerischen Analyse häufig mit einer Veröffentlichung von John von Neumann und Herman Goldstine aus dem Jahr 1947 in Verbindung gebracht wird, behaupten einige Wissenschaftler, dass ihre modernen Grundlagen auf die Arbeit von E. T. Whittaker aus dem Jahr 1912 zurückgeführt werden können.

Um manuelle Berechnungen zu vereinfachen, wurden umfangreiche Bände zusammengestellt, die Formeln und Datentabellen einschließlich Interpolationspunkten und Funktionskoeffizienten enthalten. Durch die Konsultation dieser Tabellen, die häufig auf 16 oder mehr Dezimalstellen berechnete Werte für bestimmte Funktionen lieferten, konnten Einzelpersonen die erforderlichen Werte zum Einsetzen in bestimmte Formeln abrufen und so äußerst genaue numerische Schätzungen für verschiedene Funktionen erzielen. Ein wegweisendes Werk auf diesem Gebiet ist die von Abramowitz und Stegun herausgegebene NIST-Publikation, ein umfassender Band mit mehr als 1000 Seiten, der eine umfangreiche Sammlung häufig verwendeter Formeln und Funktionen sowie deren Werte an zahlreichen Stellen auflistet. Während die tabellarischen Funktionswerte mit der weit verbreiteten Verfügbarkeit von Computern an Nutzen verloren haben, bleibt die umfangreiche Zusammenstellung von Formeln außerordentlich wertvoll.

Mechanische Taschenrechner, die ursprünglich für manuelle Berechnungen konzipiert waren, entwickelten sich in den 1940er Jahren zu elektronischen Computern. Diese frühen Computer erwiesen sich für Verwaltungsaufgaben als wertvoll und brachten das Gebiet der numerischen Analyse erheblich voran, indem sie umfangreichere und komplexere Berechnungen ermöglichten.

Das Institute of Mathematics and its Applications richtete 1985 den Leslie Fox Prize for Numerical Analysis ein.

Schlüsselkonzepte

Direkte und iterative Methoden

Direkte Methoden ermitteln die Lösung eines Problems innerhalb einer endlichen Anzahl von Rechenschritten. Theoretisch liefern diese Methoden eine genaue Antwort, wenn sie mit unendlich präziser Arithmetik ausgeführt werden. Anschauliche Beispiele sind die Gaußsche Eliminierung, die QR-Faktorisierungsmethode für lineare Gleichungssysteme und die Simplex-Methode in der linearen Programmierung. Praktische Anwendungen verwenden jedoch endliche Präzision, was zu einer Annäherung an die tatsächliche Lösung führt, abhängig von der Stabilität.

Umgekehrt sind iterative Methoden nicht darauf ausgelegt, innerhalb einer endlichen Anzahl von Schritten zu enden, selbst bei unendlicher Präzision. Ausgehend von einer ersten Schätzung generieren diese Methoden sukzessive Approximationen, die sich asymptotisch der präzisen Lösung nähern. Ein Konvergenzkriterium, das häufig auf dem Residuum basiert, wird verwendet, um festzustellen, wann eine ausreichend genaue Lösung erhalten wurde. Im Allgemeinen erreichen diese Methoden selbst bei unendlicher Präzision nicht die exakte Lösung in einer endlichen Anzahl von Schritten. Bemerkenswerte Beispiele sind die Newton-Methode, die Halbierungsmethode und die Jacobi-Iteration. Bei groß angelegten Problemen in der rechnerischen Matrixalgebra sind iterative Methoden in der Regel unverzichtbar.

Iterative Methoden werden in der numerischen Analyse häufiger eingesetzt als direkte Methoden. Bestimmte Techniken wie GMRES und die konjugierte Gradientenmethode sind grundsätzlich direkt, werden jedoch praktisch als iterative Ansätze angewendet. Dies liegt daran, dass die Anzahl der Schritte, die zum Erreichen einer exakten Lösung für diese Methoden erforderlich sind, unerschwinglich groß ist, was zur Akzeptanz einer Näherung führt, ähnlich wie bei iterativen Methoden.

Betrachten Sie zur Veranschaulichung das Problem der Lösung der Gleichung:

- 3x3 + 4 = 28

für die unbekannte Variable x.

Mit einem iterativen Ansatz kann die Halbierungsmethode auf die Funktion f(x) = 3x§67§ − 24 angewendet werden. Die festgelegten Anfangswerte sind a = 0, b = 3, f(a) = −24 und f(b) = 57.

Basierend auf diesen Ergebnissen wird festgestellt, dass die Lösung zwischen 1,875 und 2,0625 liegt. Der Algorithmus kann innerhalb dieses Intervalls jeden Wert mit einer zugehörigen Fehlermarge von weniger als 0,2 liefern.

Konditionierung

Ein schlecht konditioniertes Problem wird durch die Funktion f(x) = 1/(x − 1) veranschaulicht. Beachten Sie, dass f(1.1) = 10, während f(1.001) = 1000. Dies zeigt, dass eine geringfügige Änderung von x, insbesondere weniger als 0,1, zu einer erheblichen Änderung von f(x) von fast 1000 führt. Folglich erfolgt die Auswertung f(x) in der Nähe von x = 1 stellt ein schlecht konditioniertes Problem dar.

Im Gegensatz dazu stellt die Auswertung der identischen Funktion f(x) = 1/(x − 1) in der Nähe von x = 10 ein gut konditioniertes Problem dar. Beispielsweise ist f(10) = 1/9 ≈ 0,111 und f(11) = 0,1, was darauf hinweist, dass eine moderate Änderung von x einer moderaten Änderung von f(x) entspricht.

Diskretisierung

Darüber hinaus erfordern kontinuierliche Probleme gelegentlich eine Umwandlung in diskrete Probleme, wobei die Lösung des letzteren der des ersteren nahekommt; Dieses Verfahren wird als „Diskretisierung“ bezeichnet. Beispielsweise ist die Lösung einer Differentialgleichung eine Funktion. Um diese Funktion darzustellen, ist ein endlicher Datensatz erforderlich, beispielsweise seine Werte an einer endlichen Anzahl von Punkten innerhalb seines kontinuierlichen Bereichs.

Fehlergenerierung und -weitergabe

Die Fehleranalyse ist ein entscheidender Bestandteil der numerischen Analyse. Fehler können durch verschiedene Mechanismen in die Lösung eines Problems eingebracht werden.

Rundungsfehler

Rundungsfehler entstehen durch die inhärente Unfähigkeit digitaler Computer, die über einen endlichen Speicher verfügen, alle reellen Zahlen präzise darzustellen.

Trunkierungs- und Diskretisierungsfehler

Trunkierungsfehler entstehen, wenn eine iterative Methode beendet oder ein mathematisches Verfahren angenähert wird, was zu einer Näherungslösung führt, die von der exakten Lösung abweicht. In ähnlicher Weise führt die Diskretisierung zu einem Diskretisierungsfehler, da die Lösung des diskreten Problems nicht mit der Lösung des kontinuierlichen Problems übereinstimmt. Zum Beispiel bei der Berechnung der Lösung von , eine berechnete Wurzel von ungefähr 1,99 nach zehn Iterationen impliziert einen Kürzungsfehler von ungefähr 0,01.

Einmal aufgetretene Fehler breiten sich während der gesamten Berechnung aus. Beispielsweise ist die Additionsoperation auf einem Computer von Natur aus ungenau. Folglich eine Berechnung der Form weist einen noch größeren Grad an Ungenauigkeit auf.

Trunkierungsfehler entstehen durch die Approximation eines mathematischen Verfahrens. Zur exakten Integration einer Funktion ist eine unendliche Summation von Regionen erforderlich; Numerische Methoden können jedoch nur eine endliche Summe berechnen, was zu einer Annäherung an die exakte Lösung führt. Ähnlich verhält es sich: Während die Differenzierung einer Funktion theoretisch beinhaltet, dass das Differentialelement gegen Null tendiert, kann numerisch nur ein Wert ungleich Null für das Differentialelement ausgewählt werden.

Numerische Stabilität und wohlgestellte Probleme

Ein Algorithmus gilt als numerisch stabil, wenn sich Fehler, unabhängig von ihrer Herkunft, während des Berechnungsprozesses nicht wesentlich verstärken. Dieses Merkmal wird oft beobachtet, wenn das Problem selbst gut konditioniert ist, was bedeutet, dass geringfügige Störungen in den Eingabedaten nur zu kleinen Änderungen an der Lösung führen. Umgekehrt bedeutet ein „schlecht konditioniertes“ Problem, dass selbst geringfügige Datenfehler zu erheblichen Fehlern in der Lösung führen können. Sowohl das zugrunde liegende mathematische Problem als auch der zu seiner Lösung verwendete Algorithmus können entweder gut konditionierte oder schlecht konditionierte Eigenschaften aufweisen, was verschiedene Kombinationen ermöglicht. Folglich kann ein Algorithmus, der zur Lösung eines gut konditionierten Problems entwickelt wurde, immer noch entweder numerisch stabil oder instabil sein. Ein Hauptziel der numerischen Analyse ist die Entwicklung stabiler Algorithmen zur Lösung gut gestellter mathematischer Probleme.

Studienbereiche

Das Gebiet der numerischen Analyse umfasst zahlreiche Teildisziplinen. Zu den Hauptschwerpunkten gehören:

Werte von Funktionen berechnen

Eine grundlegende Aufgabe besteht darin, eine Funktion an einem bestimmten Punkt auszuwerten. Obwohl die direkte Einsetzung des Werts in die Formel die intuitivste Methode ist, ist sie oft nicht recheneffizient. Für Polynome bietet Horners Schema eine effizientere Alternative, indem es die erforderliche Anzahl von Multiplikationen und Additionen minimiert. Insgesamt ist die genaue Schätzung und Kontrolle von Rundungsfehlern, die aus der Gleitkomma-Arithmetik resultieren, von entscheidender Bedeutung.

Interpolation, Extrapolation und Regression

Interpolation befasst sich mit dem Problem, den Wert einer unbekannten Funktion an einem Zwischenpunkt zu bestimmen, wenn ihre Werte an einem diskreten Satz bekannter Punkte vorliegen.

Extrapolation ist eng mit der Interpolation verwandt, beinhaltet jedoch die Bestimmung des Werts einer unbekannten Funktion an einem Punkt, der außerhalb des Bereichs der gegebenen Datenpunkte liegt.

Regression weist Ähnlichkeiten mit diesen Methoden auf, berücksichtigt jedoch insbesondere die Ungenauigkeit, die beobachteten Daten innewohnt. Mit einer Reihe von Datenpunkten und entsprechenden Funktionsmessungen (jeweils fehlerbehaftet) besteht das Ziel darin, die zugrunde liegende unbekannte Funktion zu identifizieren. Die Methode der kleinsten Quadrate stellt einen gängigen Ansatz zur Lösung dieser Aufgabe dar.

Gleichungen und Gleichungssysteme lösen

Eine zentrale Herausforderung besteht darin, die Lösung für eine bestimmte Gleichung zu ermitteln, die typischerweise in lineare und nichtlineare Typen kategorisiert wird. Zum Beispiel die Gleichung stellt eine lineare Form dar, während

Bedeutende Forschung konzentrierte sich auf die Entwicklung von Methoden zur Lösung linearer Gleichungssysteme. Zu den herkömmlichen direkten Ansätzen, die Matrixzerlegungstechniken verwenden, gehören die Gaußsche Eliminierung, die LU-Zerlegung, die Cholesky-Zerlegung (für symmetrische oder hermitesche positiv-definite Matrizen) und die QR-Zerlegung (für nichtquadratische Matrizen). Für umfangreiche Systeme werden im Allgemeinen iterative Methoden wie die Jacobi-Methode, die Gauß-Seidel-Methode, die sukzessive Überrelaxation und die konjugierte Gradientenmethode bevorzugt. Umfassende iterative Strategien können durch Matrixaufteilung formuliert werden.

Nichtlineare Gleichungen werden typischerweise mithilfe von Wurzelfindungsalgorithmen behandelt, deren Name von dem Konzept abgeleitet ist, dass die Wurzel einer Funktion ein Eingabewert ist, der zu einer Ausgabe von Null führt. Wenn eine Funktion differenzierbar und ihre Ableitung zugänglich ist, ist die Newton-Methode eine häufig verwendete Option. Die Linearisierung bietet einen alternativen Ansatz zur Lösung nichtlinearer Gleichungen.

Eigenwert- und Singularwertprobleme angehen

Zahlreiche signifikante Probleme können mithilfe von Eigenwert- oder Singulärwertzerlegungen konzeptualisiert werden. Beispielsweise beruht der Spektralbildkomprimierungsalgorithmus grundsätzlich auf der Singulärwertzerlegung. Im Bereich der Statistik ist die analoge Technik als Hauptkomponentenanalyse bekannt.

Optimierungstechniken

Bei Optimierungsproblemen geht es darum, den spezifischen Punkt zu identifizieren, an dem eine bestimmte Funktion ihren maximalen oder minimalen Wert erreicht, was häufig vordefinierten Einschränkungen unterliegt.

Der Bereich der Optimierung ist in verschiedene Spezialbereiche unterteilt, die durch die Struktur der Zielfunktion und die Art der Einschränkungen bestimmt werden. Die lineare Programmierung befasst sich beispielsweise speziell mit Szenarien, in denen sowohl die Zielfunktion als auch die Einschränkungen Linearität aufweisen. Die Simplex-Methode ist ein bekannter Algorithmus innerhalb der linearen Programmierung.

Die Lagrange-Multiplikator-Methode bietet einen Mechanismus, um eingeschränkte Optimierungsprobleme in uneingeschränkte Äquivalente umzuwandeln.

Integrale Auswertung

Numerische Integration, manchmal auch als numerische Quadratur bezeichnet, zielt darauf ab, den Wert eines bestimmten Integrals zu bestimmen. Zu den weit verbreiteten Techniken gehören Newton-Cotes-Formeln (wie die Mittelpunktsregel oder die Simpson-Regel) und die Gaußsche Quadratur. Diese Ansätze verwenden ein „Teile und herrsche“-Paradigma, bei dem ein Integral über einen substantiellen Bereich in Integrale über kleinere Unterbereiche zerlegt wird. Für höherdimensionale Probleme, bei denen diese Methoden übermäßige Rechenkosten verursachen, werden häufig Monte-Carlo- oder Quasi-Monte-Carlo-Methoden verwendet, oder für mäßig große Dimensionen kann die Methode mit dünn besetzten Gittern angewendet werden.

Differentialgleichungen

Die numerische Analyse umfasst auch die Näherungsberechnung von Lösungen sowohl für gewöhnliche als auch für partielle Differentialgleichungen.

Die Auflösung partieller Differentialgleichungen beginnt typischerweise mit der Diskretisierung der Gleichung, wodurch sie in einen endlichdimensionalen Unterraum projiziert wird. Dieser Prozess kann durch Methoden wie die Finite-Elemente-Methode, die Finite-Differenzen-Methode oder, insbesondere in technischen Kontexten, die Finite-Volumen-Methode erreicht werden. Die theoretischen Grundlagen dieser Methoden stützen sich häufig auf Theoreme der Funktionalanalyse und wandeln das Problem letztendlich in die Lösung einer algebraischen Gleichung um.

Software-Implementierungen

Seit dem späten 20. Jahrhundert wurden die meisten Algorithmen in verschiedenen Programmiersprachen implementiert. Das Netlib-Repository bietet zahlreiche Software-Routinensammlungen für numerische Probleme, hauptsächlich in Fortran und C. Zu den kommerziellen Angeboten, die eine breite Palette numerischer Algorithmen umfassen, gehören die IMSL- und NAG-Bibliotheken, während die GNU Scientific Library als prominente Alternative zu freier Software dient.

Im Laufe ihrer Geschichte hat die Royal Statistical Society zahlreiche Algorithmen in ihrer Zeitschrift Applied Statistics veröffentlicht. In ähnlicher Weise hat die Association for Computing Machinery (ACM) Algorithmen in ihren Transactions on Mathematical Software vorgestellt. Das Naval Surface Warfare Center hat außerdem regelmäßig seine Bibliothek für mathematische Unterprogramme veröffentlicht.

Es gibt mehrere bekannte numerische Rechenanwendungen, darunter MATLAB, TK Solver, S-PLUS und IDL. Ergänzt werden diese durch kostenlose und Open-Source-Alternativen wie FreeMat, Scilab, GNU Octave (das Ähnlichkeiten mit Matlab aufweist) und IT++ (eine C++-Bibliothek). Darüber hinaus bieten Programmiersprachen wie R (analog zu S-PLUS), Julia und Python umfangreiche numerische Fähigkeiten durch Bibliotheken wie NumPy, SciPy und SymPy. Die Leistungsmerkmale weisen eine erhebliche Variabilität auf; Während Vektor- und Matrixoperationen normalerweise schnell ausgeführt werden, kann sich die Geschwindigkeit von Skalarschleifen um mehr als eine Größenordnung unterscheiden.

Zahlreiche Computeralgebrasysteme, einschließlich Mathematica, nutzen Arithmetik mit beliebiger Genauigkeit, um eine höhere Ergebnisgenauigkeit zu erzielen.

Darüber hinaus kann Standard-Tabellenkalkulationssoftware zur Lösung unkomplizierter numerischer Analyseprobleme eingesetzt werden. Microsoft Excel bietet beispielsweise Hunderte von Funktionen, darunter auch für Matrixoperationen, die zusammen mit der integrierten „Solver“-Funktion genutzt werden können.

Notizen

Zitate

Zeitschriften

- Numerische Mathematik, Bände 1–..., Springer, 1959–.

- Die Bände 1–66, veröffentlicht von 1959 bis 1994, sind durchsuchbar, wobei die Seiten als Bilder dargestellt werden. (Inhalt ist auf Englisch und Deutsch verfügbar)

- Journal on Numerical Analysis (SINUM), Bände 1–..., SIAM, 1964–.

Online-Texte

- "Numerical Analysis", Encyclopedia of Mathematics, EMS Press, 2001 [1994]Online-Kursmaterial

- Numerical Methods (Archiviert am 28. Juli 2009 auf der Wayback Machine), Stuart Dalziel, University of Cambridge.

- Vorlesungen über numerische Analyse, Dennis Deturck und Herbert S. Wilf, University of Pennsylvania.

- Numerische Methoden, John D. Fenton, Universität Karlsruhe.

- Numerische Methoden für Physiker, Anthony O’Hare, Universität Oxford.

- Vorlesungen in Numerischer Analyse (archiviert), R. Radok, Mahidol-Universität.

- Einführung in die numerische Analyse für das Ingenieurwesen, Henrik Schmidt, Massachusetts Institute of Technology.

- Numerical Analysis for Engineering, D. W. Harder, University of Waterloo.

- Einführung in die numerische Analyse, Doron Levy, University of Maryland.

- Numerische Analyse – Numerische Methoden (archiviert), John H. Mathews, California State University Fullerton.