En el modelado estadístico, el análisis de regresión constituye una metodología estadística para cuantificar la relación entre una variable dependiente (frecuentemente denominada resultado, respuesta o, dentro de la terminología de aprendizaje automático, una etiqueta) y una o más variables independientes (comúnmente denominadas regresores, predictores, covariables, variables explicativas o características).

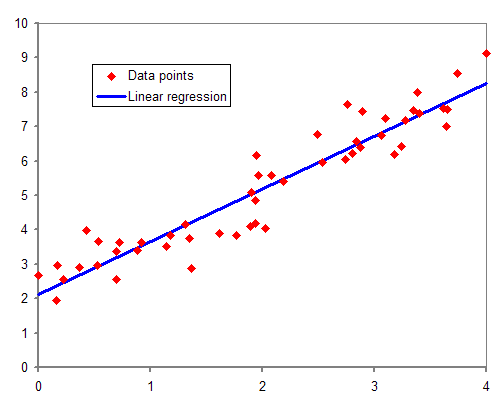

La regresión lineal representa la forma más frecuente de análisis de regresión, en la que se determina una línea (o una combinación lineal más compleja) para aproximar de manera óptima los datos en función de un criterio matemático definido. Por ejemplo, el método de mínimos cuadrados ordinario identifica la línea singular (o hiperplano) que minimiza el agregado de discrepancias al cuadrado entre los datos observados y esa línea (o hiperplano). Este enfoque permite estimar la expectativa condicional (o valor promedio poblacional) de la variable dependiente cuando las variables independientes asumen un conjunto específico de valores. Las metodologías de regresión alternativas emplean distintos enfoques procesales para cuantificar medidas alternativas de tendencia central (por ejemplo, regresión cuantil o análisis de condición necesaria) o para estimar la expectativa condicional dentro de un espectro más amplio de modelos no lineales (por ejemplo, regresión no paramétrica).

El análisis de regresión tiene dos objetivos principales, conceptualmente distintos. En primer lugar, se emplea ampliamente para la elaboración de modelos y pronósticos predictivos, un ámbito en el que su aplicación muestra una convergencia significativa con el campo del aprendizaje automático. En segundo lugar, en ciertos contextos, el análisis de regresión puede facilitar la inferencia de relaciones causales entre variables independientes y dependientes. Es importante destacar que los modelos de regresión delinean inherentemente relaciones únicamente entre una variable dependiente y un conjunto de variables independientes dentro de un conjunto de datos determinado. Para la aplicación de la regresión en la predicción o la inferencia causal, respectivamente, los investigadores deben fundamentar rigurosamente la validez predictiva de las relaciones establecidas en contextos nuevos o la interpretabilidad causal de una relación bivariada. Esta última consideración es particularmente crítica cuando los investigadores intentan estimar relaciones causales a partir de datos de observación.

Historial

La forma naciente de análisis de regresión surgió en el trabajo de Isaac Newton de 1700 sobre los equinoccios, y se le atribuye ser pionero en "un análisis de regresión lineal embrionario". Esta atribución surge del hecho de que no sólo realizó el promedio de un conjunto de datos, 50 años antes de Tobias Mayer, sino que también, al sumar los residuos a cero, obligó a la línea de regresión a atravesar el punto medio. Newton diferenció aún más entre dos conjuntos de datos heterogéneos y potencialmente conceptualizó una solución óptima con respecto al sesgo, aunque no en términos de eficacia. Anteriormente había empleado una técnica de promediación en su trabajo de 1671 sobre los anillos de Newton, una metodología sin precedentes para su época.

El método de mínimos cuadrados fue publicado de forma independiente por Legendre en 1805 y por Gauss en 1809. Tanto Legendre como Gauss aplicaron este método para determinar, a partir de observaciones astronómicas, las órbitas celestes de los cuerpos alrededor del Sol, principalmente los cometas, y posteriormente los planetas menores recientemente descubiertos. Posteriormente, Gauss publicó una exposición teórica avanzada de la teoría de mínimos cuadrados en 1821, que incorporaba una formulación del teorema de Gauss-Markov.

El término "regresión" fue introducido por Francis Galton en el siglo XIX para caracterizar un fenómeno biológico específico. Específicamente, describió la tendencia de la altura de los descendientes de ancestros altos a revertirse hacia la media de la población, un concepto también denominado regresión hacia la media. Inicialmente, para Galton, el término "regresión" tenía exclusivamente esta connotación biológica; sin embargo, Udny Yule y Karl Pearson ampliaron posteriormente su trabajo fundamental a un marco estadístico más amplio. Las contribuciones de Yule y Pearson postularon una distribución conjunta gaussiana para las variables de respuesta y explicativas. Esta premisa fue posteriormente relajada por R.A. Fisher en sus publicaciones de 1922 y 1925. Fisher planteó la hipótesis de que, si bien la distribución condicional de la variable de respuesta es gaussiana, la distribución conjunta no lo es necesariamente. En consecuencia, el supuesto de Fisher se alinea más estrechamente con la formulación de Gauss de 1821.

Durante las décadas de 1950 y 1960, los economistas utilizaban calculadoras de escritorio electromecánicas para cálculos de regresión. Antes de 1970, obtener el resultado de un único análisis de regresión podía requerir ocasionalmente hasta 24 horas.

Las metodologías de regresión siguen siendo un campo dinámico de investigación en curso. Los avances recientes han llevado al desarrollo de enfoques novedosos, que incluyen regresión sólida, métodos para respuestas correlacionadas (como series de tiempo y curvas de crecimiento), regresión que involucra objetos de datos complejos (por ejemplo, curvas, imágenes, gráficos) como predictores o respuestas, técnicas para acomodar varios tipos de datos faltantes, regresión no paramétrica, metodologías bayesianas, regresión con variables predictivas sujetas a errores de medición, regresión de alta dimensión (donde los predictores superan en número a las observaciones) y la aplicación de regresión a inferencia causal. El análisis de regresión contemporáneo se realiza comúnmente utilizando software estadístico y de hojas de cálculo especializado en computadoras, además de calculadoras científicas y gráficas.

Modelo de regresión

Por lo general, los profesionales especifican inicialmente un modelo para la estimación y posteriormente emplean una metodología seleccionada (por ejemplo, mínimos cuadrados ordinarios) para determinar sus parámetros. Los componentes fundamentales de los modelos de regresión incluyen:

- Los parámetros desconocidos, normalmente representados como un escalar o un vector .

- Las variables independientes, que se observan empíricamente y frecuentemente se simbolizan como un vector (donde indica una fila de datos).

- La variable dependiente, también observada empíricamente y comúnmente representada por el escalar .

- Los términos de error, que no son directamente observables dentro del conjunto de datos y frecuentemente están simbolizados por el escalar .

En diversos dominios de aplicaciones, se emplean terminologías alternativas para referirse a variables dependientes e independientes.

La mayoría de los modelos de regresión postulan que es una función (denominada función de regresión) de y . En esta formulación, denota un término de error aditivo, que tiene en cuenta determinantes no modelados de o ruido estadístico aleatorio inherente:

En el modelo de regresión estándar, las variables independientes, indicadas como , se supone convencionalmente que carecen de error de medición. Por el contrario, un modelo de errores en variables se vuelve aplicable cuando se postula que las variables independientes contienen errores. Además, el modelo de regresión estándar se puede adaptar mediante diversas modificaciones para abordar diversas circunstancias, incluidas aquellas que involucran variables omitidas, factores de confusión o endogeneidad.

El objetivo principal de los investigadores es estimar con precisión la función que se aproxima de manera óptima a los datos observados. Para la ejecución del análisis de regresión, la forma funcional específica de debe definirse explícitamente. En ciertos casos, esta forma funcional se deriva de una comprensión teórica a priori de la relación entre y , independiente de los datos empíricos. En caso de que dicho conocimiento previo esté ausente, una forma flexible o pragmáticamente conveniente para está seleccionado. Por ejemplo, una regresión univariada básica podría postular , lo que implica la convicción del investigador de que constituye una aproximación adecuada para el proceso de generación de datos estadísticos subyacente.

Después de seleccionar un modelo estadístico adecuado, los investigadores emplean varias técnicas de análisis de regresión para estimar los parámetros, normalmente denotados como . Por ejemplo, el método de mínimos cuadrados, particularmente su forma predominante, mínimos cuadrados ordinarios, determina el valor de que minimiza la suma de errores cuadrados, representados como . Cada metodología de regresión produce una estimación de

Es crucial reconocer la necesidad de contar con datos adecuados para estimar un modelo de regresión. Por ejemplo, considere un escenario en el que un investigador tiene acceso a

Para estimar un modelo de mínimos cuadrados con

Supuestos fundamentales

Básicamente, el análisis de regresión constituye un procedimiento computacional aplicado a un conjunto de datos. Para que la regresión resultante se interprete como un modelo estadísticamente significativo que cuantifique con precisión las relaciones del mundo real, los investigadores suelen invocar varios supuestos clásicos. Estos supuestos comúnmente abarcan:

- La muestra representa con precisión la población más amplia de la que se extrajo.

- Se supone que las variables independientes se miden sin ningún error.

- El valor esperado de las desviaciones (errores) del modelo es cero, condicionado a las covariables:

E ( e i | X i )= §3233§ - La varianza de los residuos, denotada como

e i {\displaystyle e_{i}} - Los residuales

e i {\displaystyle e_{i}}

Un conjunto específico de condiciones es suficiente para que el estimador de mínimos cuadrados exhiba propiedades deseables; específicamente, los supuestos de Gauss-Markov aseguran que las estimaciones de los parámetros sean insesgadas, consistentes y eficientes dentro de la clase de estimadores lineales insesgados. Dado que estos supuestos clásicos rara vez se cumplen precisamente en contextos empíricos, los profesionales han ideado numerosas metodologías para preservar algunas o todas estas propiedades ventajosas. Por ejemplo, el empleo de modelos de errores en variables puede producir estimaciones sólidas incluso cuando las variables independientes están sujetas a errores de medición. Los errores estándar consistentes con heterocedasticidad permiten la variación de

Regresión lineal

En regresión lineal, el modelo especifica que la variable dependiente,

- línea recta:

y i = β §2122§ + β §3233§ x i + ε i , i = §6364§, … , n . {\displaystyle y_{i}=\beta _{0}+\beta _{1}x_{i}+\varepsilon _{i},\quad i=1,\dots ,n.\!}

En la regresión lineal múltiple se incorporan múltiples variables independientes o funciones de las mismas.

Incorporando el término cuadrático

- El modelo de regresión parabólica resultante se expresa como:

y i = β §2122§ β x +i β 51§ x +i §6263§ ε ,i i = §8485§, … , n .

Esta formulación permanece dentro del dominio de la regresión lineal. Mientras que el lado derecho de la ecuación muestra una relación cuadrática con la variable independiente

En ambos lineales y modelos de regresión parabólica,

Volviendo al escenario de regresión lineal, cuando se nos proporciona una muestra aleatoria extraída de la población, procedemos a estimar los parámetros de la población, derivando así el modelo de regresión lineal muestral:

y ^ i = β ^ β ^ x i . {\displaystyle {\widehat {y}}_{i}={\widehat {\beta }}_{0}+{\widehat {\beta }}_{1}x_{i}.}

El residual, denotado como

- La suma de residuos cuadrados (SSR) se expresa formalmente como:

S S R = ∑ i = §2324§n e i §3839§ {\displaystyle SSR=\sum _{i=1}^{n}e_{i}^{2}}

Minimizar esta función genera un sistema de ecuaciones normales, que son ecuaciones lineales simultáneas que involucran los parámetros. Resolver estas ecuaciones proporciona los estimadores de parámetros, específicamente

Para modelos de regresión simples, las fórmulas utilizadas para derivar las estimaciones de mínimos cuadrados son las siguientes:

- El coeficiente estimado

β ^ §2021§ se calcula utilizando la siguiente fórmula:{\displaystyle {\widehat {\beta }}_{1}={\frac {\sum (x_{i}-{\bar) {x}})(y_{i}-{\bar {y}})}{\sum (x_{i}-{\bar {x}})^{2}}}} . - La intersección estimada

β ^ §2021§ está determinado por la ecuación:{\displaystyle {\widehat {\beta }}_{0}={\bar {y}}-{\widehat {\beta }}_{1}{\bar {x}}} .

En estas ecuaciones,

Suponiendo una varianza constante para el término de error de población, la varianza estimada se expresa como:

σ ^ ε §25 26§ = S S R n − §4748§ {\displaystyle {\hat {\sigma }}_{\varepsilon }^{2}={\frac {SSR}{n-2}}}

Esta cantidad se designa como el error cuadrático medio (MSE) de la regresión. El denominador representa el tamaño de la muestra, disminuido por el recuento de parámetros del modelo derivados del mismo conjunto de datos. Específicamente, esto se expresa como

Los errores estándar asociados con las estimaciones de los parámetros se definen como:

σ ^ β §2526§ = σ ^ ε §5556§ ∑ ( x i − x ¯ ) §89 90§ {\displaystyle {\hat {\sigma }}_{\beta _{1}}={\hat {\sigma }}_{\varepsilon }{\sqrt {\frac {1}{\sum (x_{i}-{\bar {x}})^{2}}}}}

σ ^ β §2526§ = σ ^ ε §5657§ n + x ¯ §79 80§ ∑ ( x i − x ¯ ) §115 116§ = σ ^ β §145146§ ∑ x i §166 167§ n . {\displaystyle {\hat {\sigma }}_{\beta _{0}}={\hat {\sigma }}_{\varepsilon }{\sqrt {{\frac {1}{n}}+{\frac {{\bar {x}}^{2}}{\sum (x_{i}-{\bar {x}})^{2}}}}}={\hat {\sigma }}_{\beta _{1}}{\sqrt {\frac {\sum x_{i}^{2}}{n}}}.}

Furthermore, assuming a normal distribution for the population error term, researchers can leverage these estimated standard errors to construct confidence intervals and perform hypothesis tests concerning the population parameters.

Modelo lineal general

Dentro del marco más amplio del modelo de regresión múltiple, existen

y i = β §2122§ x i §3132§+ β §42 43§ x i §5253§ + ⋯ + β p x i p + ε i , {\displaystyle y_{i}=\beta _{1}x_{i1}+\beta _{2}x_{i2}+\cdots +\beta _{p}x_{ip}+\varepsilon _{i},\,}

dónde

Las estimaciones de los parámetros de mínimos cuadrados se derivan de

ε i = y i − β ^ x i §5253§− ⋯ − β ^ p x i p . {\displaystyle \varepsilon _{i}=y_{i}-{\hat {\beta }}_{1}x_{i1}-\cdots -{\hat {\beta }}_{p}x_{ip}.}

Las ecuaciones normales se formulan de la siguiente manera:

∑ yo = §1516§n ∑ k = §3233§p x yo j x yo k β ^ k = ∑ yo = §8990§n x yo j y yo , j = §123124§, … , p . {\displaystyle \sum _{i=1}^{n}\sum _{k=1}^{p}x_{ij}x_{ik}{\hat {\beta }}_{k}=\sum _{i=1}^{n}x_{ij}y_{i},\ j=1,\dots ,p.\,}

En notación matricial, las ecuaciones normales se expresan de la siguiente manera:

( X ⊤ X ) β ^ = X ⊤ Y , {\displaystyle \mathbf {(X^{\top }X){\hat {\boldsymbol {\beta }}}={}X^{\top }Y} ,\,}

En este contexto, la

β ^ = ( X ⊤ X ) − §4142§X ⊤ Y . {\displaystyle \mathbf {{\hat {\boldsymbol {\beta }}}=(X^{\top }X)^{-1}X^{\top }Y}.\,}

Diagnóstico

Al construir un modelo de regresión, verificar su bondad de ajuste y la significancia estadística de sus parámetros estimados se vuelve crucial. Los métodos estándar para evaluar la bondad del ajuste abarcan valores de R cuadrado, análisis de patrones residuales y pruebas de hipótesis. La significancia estadística del ajuste general del modelo se puede evaluar mediante una prueba F, complementada posteriormente con pruebas t para parámetros individuales.

La interpretación de estas pruebas de diagnóstico depende críticamente de los supuestos subyacentes del modelo. Si bien el análisis residual puede invalidar efectivamente un modelo, los resultados de las pruebas t o F pueden resultar difíciles de interpretar cuando se violan estos supuestos. Por ejemplo, en muestras pequeñas, una distribución no normal del término de error puede dar lugar a parámetros estimados que no se ajustan a las distribuciones normales, complicando así la inferencia estadística. Por el contrario, con muestras suficientemente grandes, se puede aplicar el teorema del límite central, lo que permite probar hipótesis mediante aproximaciones asintóticas.

Variables dependientes limitadas

En econometría, con frecuencia aparecen variables dependientes limitadas, caracterizadas como variables de respuesta que son categóricas o restringidas a un rango específico de valores.

Las variables de respuesta pueden ser no continuas, lo que significa que están restringidas a un subconjunto de la línea real. Cuando se analizan variables binarias (cero o uno) mediante regresión lineal de mínimos cuadrados, el enfoque se denomina modelo de probabilidad lineal. Para las variables dependientes binarias, las alternativas no lineales incluyen los modelos probit y logit. El modelo probit multivariado sirve como técnica convencional para estimar la relación conjunta entre múltiples variables dependientes binarias y un conjunto de variables independientes. Para variables categóricas que poseen más de dos valores, se emplea el modelo logit multinomial. De manera similar, para variables ordinales con valores múltiples, se utilizan modelos logit ordenado y probit ordenado. Los modelos de regresión censurados son aplicables cuando la variable dependiente solo se observa parcialmente, mientras que los modelos de corrección de Heckman abordan situaciones en las que la muestra no se extrae aleatoriamente de la población objetivo.

Como alternativa, la regresión lineal se puede realizar utilizando correlaciones policóricas o poliseriales entre variables categóricas. Estas metodologías se distinguen por sus diferentes supuestos con respecto a la distribución poblacional de las variables. Cuando una variable es positiva, muestra valores bajos y representa la frecuencia de ocurrencia de un evento, los modelos de conteo como la regresión de Poisson o el modelo binomial negativo son apropiados.

Regresión no lineal

Cuando la función del modelo no es lineal con respecto a sus parámetros, minimizar la suma de cuadrados requiere un procedimiento iterativo. Este enfoque introduce numerosas complejidades inherentes a las metodologías de mínimos cuadrados no lineales.

Predicción (interpolación y extrapolación)

Los modelos de regresión se utilizan para predecir el valor de una variable Y en función de los valores conocidos de las variables X. La predicción dentro del rango de datos observados utilizado para el ajuste del modelo se denomina comúnmente interpolación. Por el contrario, la predicción fuera de este rango de datos se denomina extrapolación. La validez de la extrapolación depende en gran medida de los supuestos subyacentes de la regresión. A medida que aumenta el alcance de la extrapolación más allá de los datos observados, aumenta el potencial de falla del modelo debido a discrepancias entre los supuestos del modelo y los datos de muestra o los valores reales de la población.

Un intervalo de predicción, que cuantifica la incertidumbre inherente, puede acompañar a una predicción puntual. Estos intervalos generalmente se amplían significativamente a medida que las variables independientes se desvían más del rango abarcado por los datos observados.

En consecuencia, y por otras razones relacionadas, a menudo se considera poco aconsejable realizar una extrapolación.

Selección de modelo

La asunción de una forma funcional específica para la relación entre Y y X introduce una fuente adicional de incertidumbre. Si bien un análisis de regresión ejecutado meticulosamente evaluará la congruencia entre la forma asumida y los datos observados, esta evaluación está inherentemente limitada al rango de valores de variables independientes realmente disponibles. En consecuencia, cualquier extrapolación se vuelve particularmente dependiente de los supuestos subyacentes respecto de la forma estructural de la relación de regresión. Si el conocimiento previo indica que la variable dependiente no puede exceder o caer por debajo de ciertos límites, esta información se puede aprovechar durante la selección del modelo, incluso si el conjunto de datos observado no contiene valores cercanos a estos límites. Las implicaciones de elegir una forma funcional apropiada para la regresión pueden ser sustanciales, especialmente cuando se considera la extrapolación, ya que puede, como mínimo, garantizar que cualquier resultado extrapolado de un modelo ajustado sea "realista" o consistente con el conocimiento establecido.

Cálculos de potencia y tamaño de muestra

No existe un consenso universal sobre las metodologías para relacionar el número de observaciones con el número de variables independientes dentro de un modelo. Un enfoque, conjeturado por Good y Hardin, se expresa como

iniciar sesión 1000 iniciar sesión §2324§ ≈ 4,29 {\displaystyle {\frac {\log 1000}{\log 5}}\approx 4.29}

Otros métodos

Si bien los parámetros de un modelo de regresión generalmente se estiman utilizando el método de mínimos cuadrados, se han empleado varias metodologías alternativas, que incluyen:

- Métodos bayesianos, como la regresión lineal bayesiana.

- La regresión porcentual, utilizada para minimizar los errores porcentuales, se considera más adecuada.

- Desviaciones mínimas absolutas, una técnica que ofrece mayor solidez frente a valores atípicos y conduce a una regresión cuantil.

- Regresión no paramétrica, que requiere un número sustancial de observaciones y requiere un uso computacional intensivo.

- Optimización de escenarios, que da como resultado el desarrollo de modelos predictores de intervalos.

Software

Todos los paquetes de software estadístico destacados son capaces de realizar inferencias y análisis de regresión de mínimos cuadrados. La regresión lineal simple y la regresión múltiple utilizando mínimos cuadrados también se pueden ejecutar en determinadas aplicaciones de hojas de cálculo y en algunas calculadoras. Sin embargo, si bien muchos paquetes de software estadístico pueden realizar varios tipos de regresión robusta y no paramétrica, estos métodos exhiben menos estandarización. Diferentes paquetes de software implementan distintas metodologías, y un método que lleva un nombre particular puede implementarse de manera diferente en varios paquetes. También se ha desarrollado software de regresión especializado para su aplicación en campos como el análisis de encuestas y la neuroimagen.

Referencias

Kruskal, William H. y Judith M. Tanur, eds. (1978). "Hipótesis lineales". En Enciclopedia Internacional de Estadística, vol. 1. Prensa libre.

- William H. Kruskal y Judith M. Tanur, ed. (1978), "Hipótesis lineales", Enciclopedia Internacional de Estadística. Prensa libre, v.1,

- Williams, Evan J. "I. Regresión". págs. 523–41.

- Stanley, Julian C. "II. Análisis de varianza". págs. 541–554.

- Lindley, D.V. (1987). "Análisis de regresión y correlación". En *New Palgrave: Diccionario de economía*, vol. 4, págs. 120–23.

- Birkes, David e Y. Dodge. Métodos alternativos de regresión. ISBN 0-471-56881-3.

- Chatfield, C. (1993). "Cálculo de pronósticos de intervalo". Revista de estadísticas económicas y empresariales, 11, págs. 121–135.

- Draper, N.R. y H. Smith. (1998). Análisis de regresión aplicada (3ª ed.). Juan Wiley. ISBN 978-0-471-17082-2.Meade, Nigel y Towhidul Islam. (1995). "Prediction Intervals for Growth Curve Forecasts". Journal of Forecasting, 14 (5): 413–430.Chicco, Davide, Matthijs J. Warrens y Giuseppe Jurman. (2021). "El coeficiente de determinación R-cuadrado es más informativo que SMAPE, MAE, MAPE, MSE y RMSE en la evaluación del análisis de regresión". PeerJ Computer Science, 7 (e623): e623. PMC 8279135. PMID 34307865."Análisis de regresión". En Encyclopedia of Mathematics. EMS Press, 2001 [1994].

- "Análisis de regresión", Enciclopedia de Matemáticas, EMS Press, 2001 [1994]Fuente: Archivo de la Academia TORIma